%matplotlib inline

from ipywidgets import *

import matplotlib.pyplot as plt

from IPython.display import set_matplotlib_formats

set_matplotlib_formats('svg')

import numpy as np

import scipy.stats as stats

def regression(slope=5, sd=0, show=False):

fig, axes = plt.subplots(figsize=(7,7))

x = np.linspace(0, 1, 100)

yt = 1 + slope * x

plt.plot(x, yt)

y = yt+ np.random.normal(0,sd,100)

plt.scatter(x, y)

my = np.mean(y)

ssr = sum((yt-my)**2)

sse = sum((y-yt)**2)

sst = ssr+sse

plt.ylim(-30,30)

if show:

plt.title("SST="+str(round(sst,2))+" SSR="+str(round(ssr, 2))+" SSE="+str(round(sse,2)))

Analiza regresji¶

interact(regression,slope=fixed(5), sd=(0,10,1))

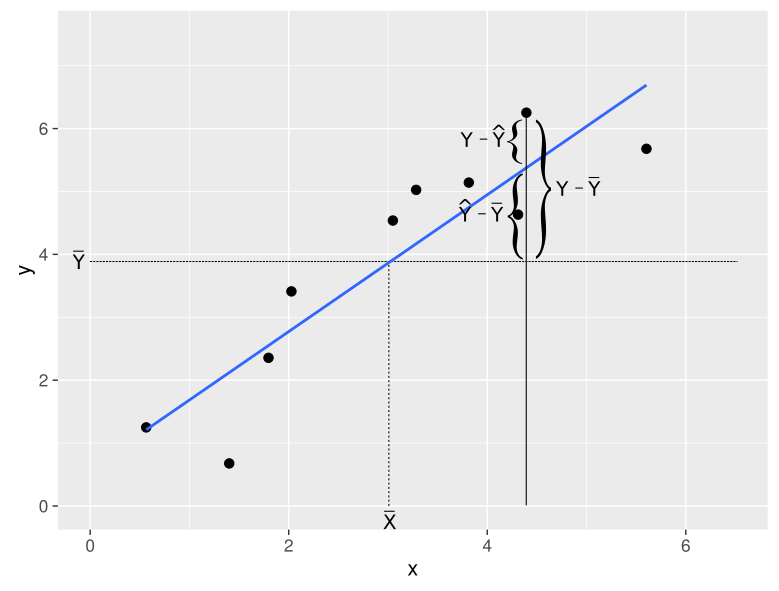

Rozkład zmienności Y¶

interact(regression,slope=fixed(5), sd=(0,10,1))

dla $\hat{y}_i=y_i$:

$$ SSE = \sum\limits_{i=1}^n (y_i-\hat{y_i})^2 = 0 $$

dla $b_1=0$:

$$SSR = \sum\limits_{i=1}^n (\hat{y_i}-\bar{y})^2 = \sum\limits_{i=1}^n (b_0+b_1x_i-\bar{y})^2=n(b_0-\bar{y})^2=n(\bar{y}-b_1\bar{x}-\bar{y})^2=0$$

Współczynnik determinacji¶

- Całkowita suma kwadratów odchyleń:

- Współczynnik determinacji:

- $R^2$ jest kwadratem współczynnika korelacji:

- Skorygowany współczynnik determinacji:

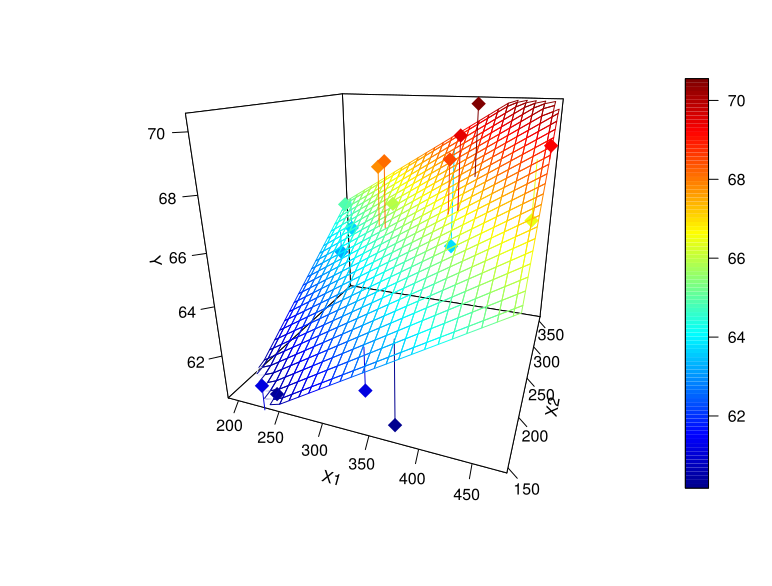

Regresja wieloraka¶

$Y=\beta_0+\beta_1X_1+\beta_2X_2+\epsilon$

Globalny test istotności (F)¶

- Układ hipotez:

$\;\;\;\;\;H_0: \beta_1=\beta_2=...=\beta_k=0$

$\;\;\;\;\;H_1:$ Nie wszystkie $\beta_i$ (i=1, 2, ..., k) sa równe $0$

- Statystyka testowa:

- $n$ - liczba obserwacji

- $k$ - liczba zmiennych objaśniających

| Suma kwadratów odchyleń | df | Średnie odchylenie kwadratowe |

|---|---|---|

| SSR | k | $MSR=\frac{SSR}{k}$ |

| SSE | n-(k+1) | $MSE = \frac{SSE}{n-(k+1)}$ |

Z próbki o liczności $n=24$ zbudowano model regresji wielorakiej wykorzystując 3 zmienne objaśniające. Uzyskano $SSR=36$ i $SSE=20$. Zweryfikuj statytyczną istotność modelu na poziomie $\alpha=0.05$.

$H_0: \beta_1=\beta_2=\beta_3=0$

$H_1:$ Nie wszystkie $\beta_i$ (i=1, 2, 3) sa równe $0$

$C_{kr}$ = (3.098, inf)

MSR=36/3=12

MSE= 20/(24-(3+1))=1

F=12/1=12

Odrzucamy $H_0$ na rzecz $H_1$

Test istotności parametru modelu (t)¶

- Układ hipotez:

$\;\;\;\;\;H_0: \beta_i=0$

$\;\;\;\;\;H_1: \beta_i\neq0$

Statystyka testowa:

$$t = \frac{b_i}{S(b_i)} \sim t(n-(k+1))$$

Standardowy błąd oszacowania¶

- Suma kwadratów błędów (rezyduów):

- MSE:

- Standardowy błąd oszacowania: